Scale-aware Automatic Augmentation for Object Detection

code: GitHub - dvlab-research/SA-AutoAug: Scale-aware Automatic Augmentation for Object Detection (CVPR 2021)

paper: https://arxiv.org/pdf/2103.17220.pdf

目录

1 Motivation

2 Methods

2.1 搜索空间

2.2 评价指标

2.3 搜索算法

2.4 整体框架

3 实验

数据增强包括两个发展方向,一类是数据增强方法,另外一类是数据增强的组合策略。本文延续了AutoAugment的思路,提出一种适合目标检测的数据增强策略搜索方法。

数据增强的组合策略问题一般包括三个部分:(1)搜索空间;(2)搜索算法;(3)评价指标。例如:对AutoAugment,数据增强策略包含五个子策略(sub-policy),每个子策略包括两个操作(operations),每个操作对应一种数据增强方法的强度和执行概率;搜索算法使用强化学习算法;评价指标是模型在代理任务(训练集子集)上训练测试。

1 Motivation

[ECCV-20] Learning data augmentation strategies for object detection存在两个问题

(1)box-level augmentation直接在bbox中执行,和背景差异大,降低了网络定位增强目标的难度。解决方法:本文提出基于高斯,按比例渐近地融合原图片和增强操作,使得box-level增强更加自然丝滑;

(2)toy experiment显示:不同大小的目标受背景影响程度不同。例如:对于小目标,去除背景是有害的;对于大目标,去除背景有益的:

受此启发,作者认为针对不同大小的目标,应该有不同的背景尺度,例如:对于小目标,就应该囊括更多的背景,因为他们的检测受背景影响大。具体来说,对于某个图片H x W和检测框(xc, yc, h, w),高斯映射(Gaussian map)为:

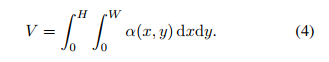

增强区域V定义为:

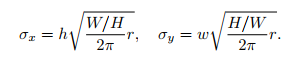

对box-level增强方法的区域比例定义为r,是可搜索的: 。因此,标准差可以通过下式算得:

。因此,标准差可以通过下式算得:

2 Methods

2.1 搜索空间

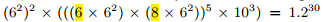

image-level Aug -> (Color box-level Aug -> Geometric box-level Aug)^5 -> scale ratios,其中image-level Aug包括zoom-in/out,Color和Geometric Aug见下图,每种增强方法包括6个离散的执行概率和6个执行强度;area ratios包括small, middle和Large三种,每种包括10个离散值,因此,整体搜索空间为:

2.2 评价指标

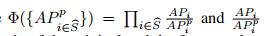

首先训练一个模型,记录它在验证集上的准确率,和每个尺度目标的准确率;然后将该模型在子策略上进一步fine-tune,记录子模型各个尺度目标的损失和准确率。目标函数如下:

包括两个部分:(1)损失的标准差:各个尺度目标对应的损失要求方差尽可能小;(2)Pareto Optimality惩罚fine-tune后效果变差的项。

2.3 搜索算法

进化算法,例如:tournament selection algorithm。验证集包含5k张图片,从MS COCO的train2017中随机采样;剩下的部分用于子模型训练;每个子模型fine-tune 1k iterations。进化搜索中,进化过程迭代10次,初始种群大小设为50,选择最好的10个作为下一代的父母。

2.4 整体框架

3 实验

和Baseline和Multi-scale training baseline作比较,其中MS Baseline,通过随机选择640-800中的一个尺度去训练。